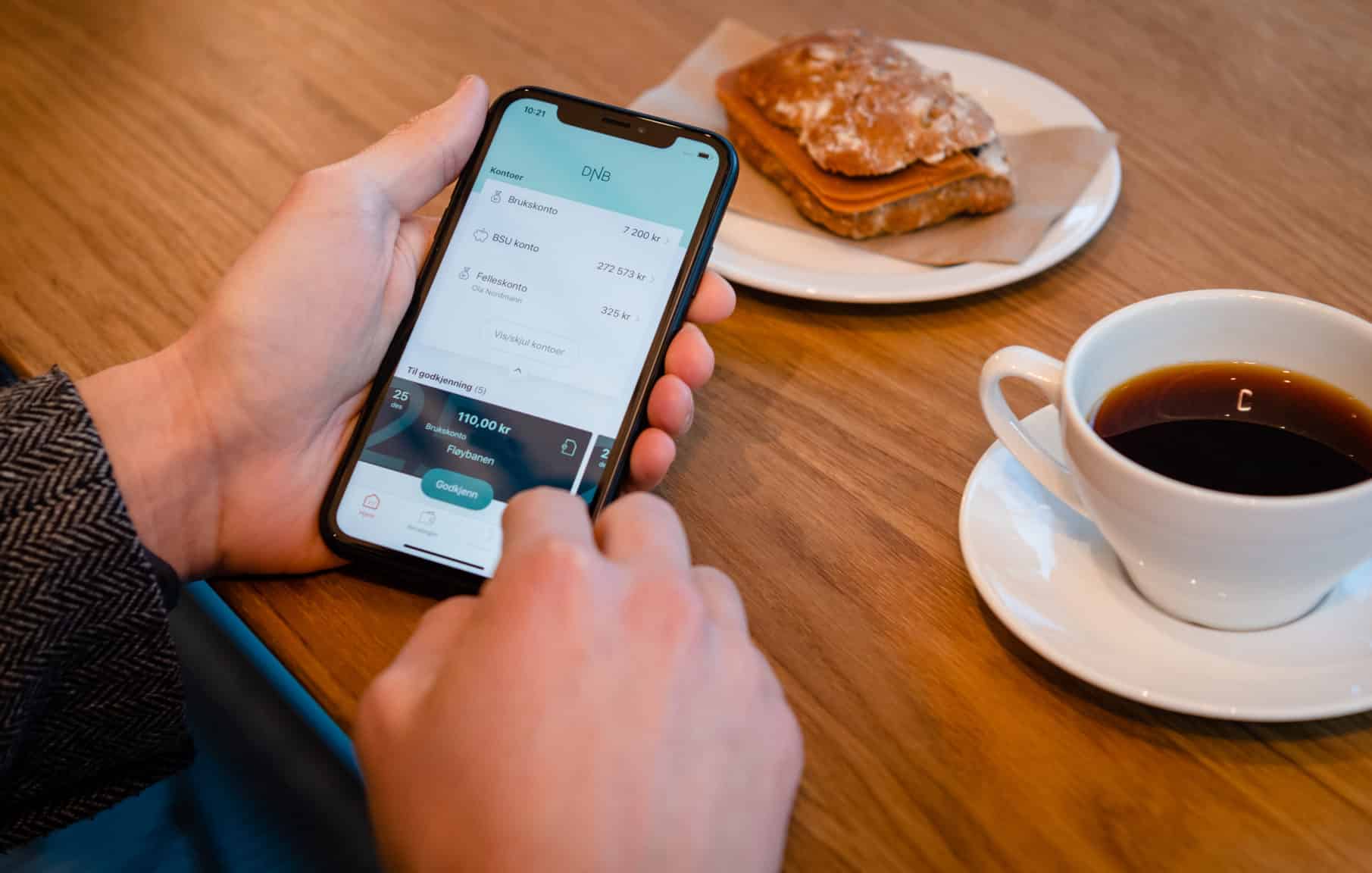

Er det ikke du selv som sitter i nettbanken din og overfører penger til utlandet, kan det kjapt bli avslørt – ved hjelp av kunstig intelligent teknologi.

– Jeg liker ikke å kalle det «kunstig intelligens», sier Roger Olafsen.

Han er leder for avansert analyse og maskinlæring i DNBs antihvitvasking divisjon … eller med andre ord for det mange vil kalle nettopp kunstig intelligens (KI). Men det er upresist.

Kanskje litt som at en webutvikler skulle sagt at hun «jobber med internett».

– Det skaper bare mer forvirring. Jeg kaller dette heller det det er, nemlig maskinlæring, sier Olafsen.

Kall det hva du vil: Maskinlæring er i alle tilfeller noe som nå blir stadig mer utbredt. Det er en underkategori av KI, og det er dette som ligger bak alt fra selvkjørende biler til smarte høyttalere, innholdet i Instagram-feeden din og datagenererte kunstverk.

Nå tas teknologien også i bruk på tvers av det norske næringslivet. Og noen av dem som er kommet aller lengst, er nettopp bank- og forsikringsbransjen.

– Det er ikke nytt for oss, det er blitt brukt lenge, for eksempel i forbindelse med å vurdere risiko på lån, og den typen ting. Men nå brukes det på flere måter og mange nye områder, sier Olafsen.

– På mitt område handler det fremfor alt om å bruke maskinlæring til å prøve å finne mistenkelige transaksjoner, sier han.

Avslører identitetstyveri

Maskinlæring innebærer å bruke matematiske og statistiske metoder til å oppnå bestemte mål basert på data. Et slikt mål kan være å oppdage avvik og mistenkelig aktivitet på en bankkonto.

– Innen bank og finans brukes det primært til vurdering av risiko – både operasjonelt og økonomisk, forklarer Roger Olafsen.

– Vi bruker det blant annet til å avdekke og forhindre forsøk på svindel og hvitvasking, og sørge for at ting er trygt for kundene våre. Men det brukes også på områder som kredittvurderinger og prisoptimalisering – for eksempel pris og betingelser på et lån. Og det er en etisk dimensjon i det, idet det brukes til å sørge for at kunder blir mer likt behandlet, sier han.

Skadelig bruk av kunstig intelligens er noe som ofte kommer frem i media, spesielt de store aktørenes innsamling og analyse av brukeradferd for markedsføring, påpeker Olafsen. De positive bruksområdene hører vi mindre om.

– Som for eksempel at det kan avdekke om det faktisk er deg som er innlogget i nettbanken, basert på din tidligere brukeradferd. Ved å se på bruksmønstre på denne måten med maskinlæring, kan vi avsløre og avverge identitetstyveri, sier han.

Brukes til antihvitvasking

Selv jobber Olafsen og avdelingen hans primært med antihvitvasking – og forhindring av at penger fra kriminell virksomhet som menneskehandel og narkotikaomsetning, kommer inn i den lovlige økonomien, eller går til å finansiere terror.

En viktig del av dette er å ha systemer på plass som raskt kan oppdage mistenkelige transaksjoner. Slike systemer kan enten være regelbaserte, eller bruke maskinlæring.

– Et eksempel på en regel – som altså ikke involverer maskinlæring – er at det kan gå en alarm hvis noen for eksempel sender penger til et land som er ansett som et høyrisikoland, sier Olafsen, og legger til:

– Men det kan være lovlige grunner til å sende de pengene.

Maskinlæringsmodellene på sin side kan trenes opp på utfall der det faktisk har vært ulovlig aktivitet – og kan deretter finne lignende mønstre flere steder.

– Poenget med å bruke maskinlæring, er at vi kan vurdere sannsynligheten for et utfall mye mer presist enn med enkle regler, sier Olafsen.

Ingenting magisk med ML

Selv om DNB er kommet langt i å bruke maskinlæring på denne måten, er det likevel en del utfordringer som må overkommes for at teknologien skal nå sitt fulle potensial. Blant annet er det utfordrende å få tak tilstrekkelig med data av god kvalitet til å trene disse modellene.

– Når en hører om kunstig intelligens, er det lett å tenke at her kan det magiske skje. Men vi som lager modeller, vet at det er vanskelig å lage modeller på noe som inntreffer sjeldent, sier Olafsen.

Banken gjennomfører nemlig enorme mengder transaksjoner, og de aller fleste av dem er lovlige. Det gjør at datasettet blir skjevt, når en ser etter de som er ulovlige.

– Å samle og klargjøre dataene er 90 prosent av jobben. Å trene en modell er greit nok når vi først har dataene, sier han.

Videre kan maskinlæring kun finne forhold som den er trent for, og som faktisk har inntruffet tidligere.

– Magien som mange kan oppfatte med kunstig intelligens, som at teknologien kan finne ut nye forhold av seg selv, er så langt en fiksjon.

Det vil likevel ikke si at dette allerede er effektivt og nyttig – eller at det ikke skjer mye spennende og lovende på området:

– Et ganske hett område vi ser på nå, er bruk av nettverksgrafer og ML-algoritmer, sier Olafsen, og utdyper:

– Tenk på nettverk som vennenettverket ditt på Facebook eller ditt profesjonelle LinkedIn-nettverk. I vårt tilfelle er nettverket finansielle transaksjoner, i kombinasjon med kompliserte selskapsstrukturer og annen informasjon. Her kan vi for eksempel trene modeller på tidligere mistenkelig avslørt adferd.

– ML kan gjøre feil, men det gjør også mennesker

En annen utfordring DNB opplever i dette arbeidet, er at de som bank kun sitter på én del av historien i komplekse transaksjoner.

– Når vi for eksempel ser etter hvitvasking, kan mange land og mange banker være involvert, og vi ser bare vårt bilde. For å løse det store bildet, er man avhengig av at bankene deler data med hverandre, noe som man ikke kan gjøre i dag på grunn av flere regulative forhold som for eksempel regler for behandling av persondata, sier Olafsen.

Mønstrene som algoritmene finner som mistenkelige, vil også forekomme blant mange lovlige transaksjoner. Olafsen legger til at det derfor oppstår en del falske positive, og dermed falske alarmer.

– Per nå er det likevel sånn at når en alarm først har gått, så blir den alltid fulgt opp.

– Med maskinlæring kan vi se med stor sannsynlighet om en alarm er falsk eller ikke, basert på tidligere saker. Dette hjelper oss i dag med å prioritere hvilke saker vi skal behandle først. På sikt ser vi også for oss å bruke teknologien for å effektivisere selve behandlingen av alarmene.

– Maskinlæring kan ta feil, men det gjør også mennesker, og gode ML algoritmer gjør mindre feil enn alternativene.

For saksbehandlerne er det også en tilvenning og en modningsprosess å skulle jobbe med maskinlæringsmodeller i tillegg til mer tradisjonelle, regelbaserte systemer. Dette er fortsatt under utvikling – og krever helt ny kompetanse.

– Der mennesker er involvert i prosessen, er det viktig med god beslutningsstøtte for å forstå utfallet av en ML-modell, sier Olafsen.